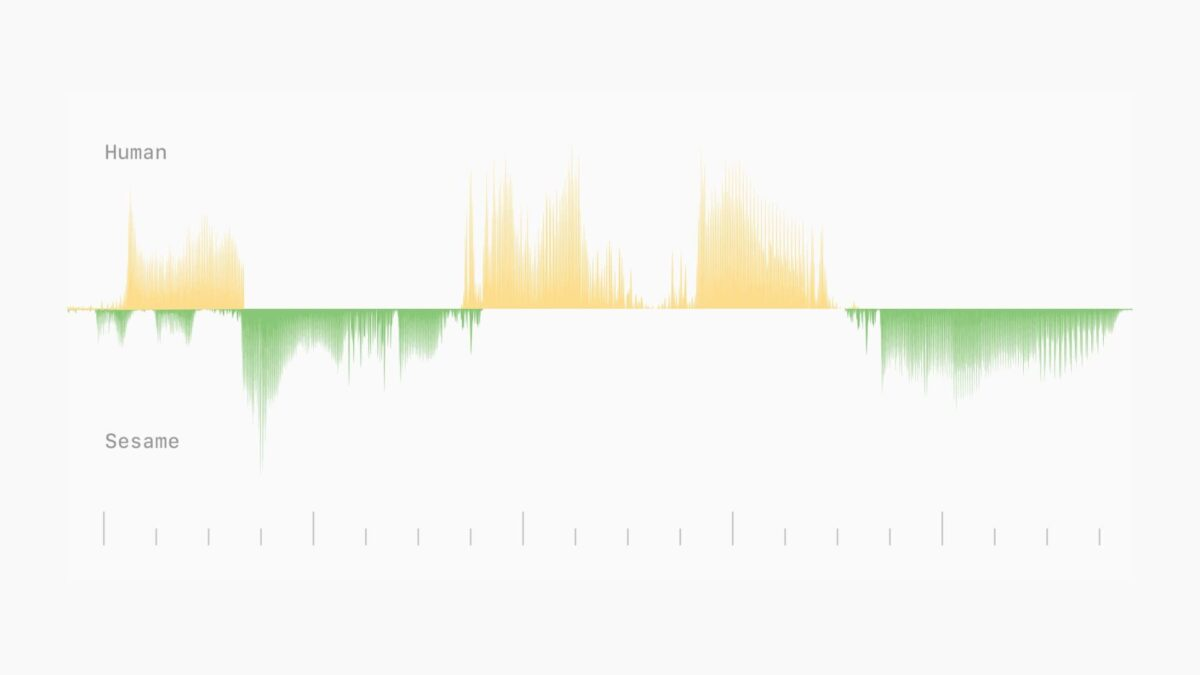

Согласно результатам предварительного тестирования, наиболее впечатляющими особенностями Sesame являются такие тонкие элементы, как микропаузы, акценты и смех во время разговора. В одном из диалогов аватар Sesame Майя в режиме реального времени отреагировала на внезапный смех пользователя, продемонстрировав эмоциональную осведомлённость.

Система намеренно имитирует человеческое поведение, например, исправляет себя в середине предложения и извиняется за перерывы в речи. Techradar особо отметил эти намеренные несовершенства, подчеркнув, что они отличаются от отполированного корпоративного стиля ChatGPT или Gemini.

В смоделированных сценариях, таких как обсуждение стресса на работе или планирование вечеринки, система предлагала контекстуально подходящие ответы и вопросы, а не использовала шаблонные фразы.

Система обрабатывает речь, используя семантические маркеры для лингвистических свойств и фонетики, а также акустические маркеры для таких характеристик звука, как высота тона и ударение. Для оптимизации обучения аудиодекодер обучается только на одной шестнадцатой части аудиокадров, в то время как семантическая обработка использует весь набор данных.

Модель обучалась на одном миллионе часов аудиоданных на английском языке за пять эпох. Она может обрабатывать последовательности из 2048 токенов (около двух минут аудио) в сквозной архитектуре. Этот подход отличается от традиционных систем преобразования текста в речь интегрированной обработкой текста и аудио.

В ходе слепых тестов с Sesame участники не могли отличить CSM от реальных людей во время коротких диалогов. Однако в более длинных диалогах всё же проявлялись ограничения, такие как случайные неестественные паузы и звуковые дефекты.

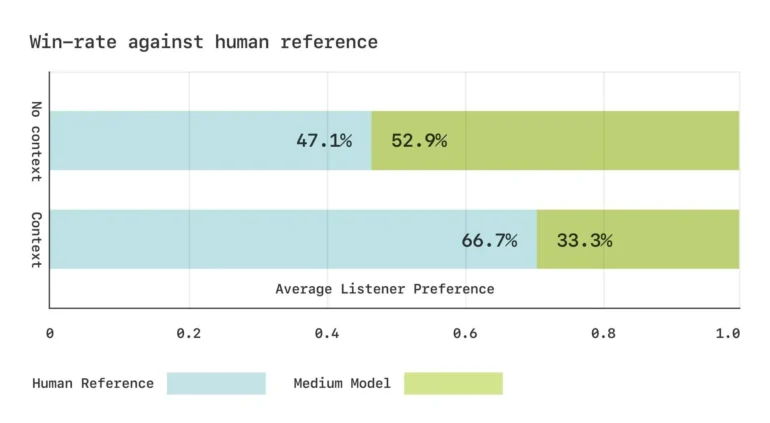

Sesame разработала специальные фонетические тесты для оценки эффективности модели. В тестах на восприятие на слух участники оценили сгенерированную речь как эквивалентную реальным записям, когда она звучала без контекста, хотя при наличии контекста они всё равно предпочитали оригинал.

Предпочтение, которое испытуемые отдают речи, сгенерированной ИИ, достигает почти человеческого уровня.

Sesame планирует выпустить ключевые компоненты своего исследования в открытом доступе по лицензии Apache 2.0. В ближайшее время они намерены увеличить масштаб модели и расширить охват обучения, включив в него более 20 языков.

Компания акцентирует внимание на интеграции предварительно обученных языковых моделей и создании систем с полным дуплексом. Эти системы способны анализировать динамику разговора, включая смену говорящих, паузы и скорость речи, непосредственно на основе данных. Для достижения этой цели потребуются значительные изменения во всех аспектах обработки, начиная с работы с данными и заканчивая методами последующей обработки.

«Создать цифрового компаньона с голосовым сопровождением непросто, но мы стабильно продвигаемся по нескольким направлениям, включая индивидуальность, память, выразительность и уместность», — отмечают разработчики.

Компания Sesame AI, основанная бывшим техническим директором Oculus Бренданом Ирибе и его командой, получила значительное финансирование серии A от Andreessen Horowitz. Демо-версия уже доступна.

Влияние естественных голосов ИИ на востребованность ассистентов стало очевидным благодаря повышенному интересу к расширенным голосовым функциям ChatGPT. Голосовые помощники на базе больших языковых моделей, вероятно, будут становиться всё более распространёнными, о чём свидетельствует выпуск Amazon Alexa+